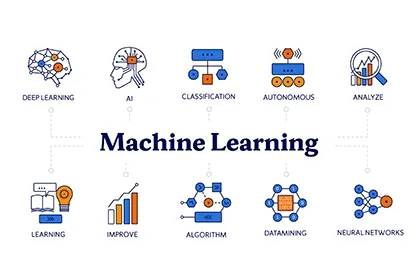

شبکه های عصبی مکرر (RNN)

دومین معماری محبوب امروز. شبکه های مکرر موارد مفیدی مانند ترجمه دستگاه عصبی به ما دادند ، تشخیص صدا و ترکیب صدا در دستیاران هوشمند. RNN بهترین برای داده های متوالی مانند صدا ، متن یا موسیقی است.

آیا مایکروسافت سام ، سازنده گفتار قدیمی مدرسه از ویندوز XP را به خاطر دارید؟ آن مرد خنده دار کلمات را با نامه می سازد ، و سعی می کند تا آنها را به هم بچسباند. اکنون به Amazon Alexa یا Assistant از Google نگاه کنید. آنها نه تنها کلمات را به روشنی بیان می کنند بلکه حتی لهجه های مناسب را نیز قرار می دهند!

همه به این دلیل که دستیاران صوتی مدرن آموزش دیده اند که نه به صورت نامه ، بلکه در کل عبارات یکباره صحبت کنند. ما می توانیم مجموعه ای از متون با صدای بلند را تهیه کرده و یک شبکه عصبی را آموزش دهیم تا یک دنباله صوتی نزدیک به گفتار اصلی تولید شود.

به عبارت دیگر ، ما از متن به عنوان ورودی و صوت آن به عنوان خروجی مورد نظر استفاده می کنیم. ما از یک شبکه عصبی می خواهیم تا برای متن داده شده صوتی ایجاد کند ، سپس آن را با خطاهای اصلی ، درست مقایسه کرده و سعی کنید تا حد ممکن به ایده آل نزدیک شوید.

به نظر می رسد مانند یک فرایند یادگیری کلاسیک. حتی یک پرسپترون برای این کار مناسب است. اما چگونه باید خروجی های آن را تعریف کنیم؟ شلیک یک خروجی خاص برای هر عبارت ممکن یک گزینه نیست - بدیهی است.

در اینجا ما به این واقعیت کمک خواهیم کرد که متن ، گفتار یا موسیقی توالی هستند. آنها از واحدهای متوالی مانند هجا تشکیل شده اند. همه آنها بی نظیر به نظر می رسند اما به موارد قبلی بستگی دارند. این اتصال را گم کنید و dubstep شوید.

ما می توانیم پرسپترون را برای تولید این صداهای بی نظیر آموزش دهیم ، اما چگونه پاسخ های قبلی را به خاطر می آوریم؟ بنابراین ایده این است که حافظه را به هر نورون اضافه کرده و از آن به عنوان ورودی اضافی در مرحله بعد استفاده کنیم. یک نورون می تواند برای خودش یادداشت بگذارد - سلام ، ما اینجا صدایی داشتیم ، صدای بعدی باید بیشتر صدا کند (این یک نمونه بسیار ساده است).

به این ترتیب شبکه های مکرر ظاهر شدند.

این رویکرد یک مشکل بزرگ داشت - وقتی همه سلولهای عصبی نتایج گذشته خود را به خاطر آوردند ، تعداد اتصالات در شبکه به حدی عظیم شد که تنظیم همه وزنها از نظر فنی غیرممکن بود.

این رویکرد یک مشکل بزرگ داشت - وقتی همه سلولهای عصبی نتایج گذشته خود را به خاطر آوردند ، تعداد اتصالات در شبکه به حدی عظیم شد که تنظیم همه وزنها از نظر فنی غیرممکن بود.

وقتی یک شبکه عصبی نمی تواند فراموش کند ، نمی تواند چیزهای جدیدی یاد بگیرد (مردم نقص یکسانی دارند).

اولین تصمیم ساده بود: حافظه نورون را محدود کنید. بیایید بگوییم ، برای حفظ بیش از 5 نتیجه اخیر. اما این ایده را شکست.

بعداً یک رویکرد بسیار بهتر انجام شد: استفاده از سلولهای ویژه ، مشابه حافظه کامپیوتر. هر سلول می تواند یک عدد را ضبط کند ، آن را بخواند یا دوباره تنظیم کند. سلولهای حافظه بلند مدت و کوتاه مدت (LSTM) نامیده می شدند.

حال وقتی یک نورون نیاز به یادآوری دارد ، پرچمی را در آن سلول قرار می دهد. مانند "این در یک کلمه همخوان بود ، دفعه بعد از قوانین تلفظ مختلف استفاده کنید". هنگامی که دیگر پرچم مورد نیاز نیست ، سلول ها مجدداً تنظیم می شوند و تنها اتصالات "بلند مدت" پرسپترون کلاسیک باقی می مانند. به عبارت دیگر ، این شبکه نه تنها برای یادگیری وزن بلکه برای تنظیم این یادآوری ها آموزش داده می شود.

پایان: وقت جنگ با ماشین آلات است؟

مشکل اصلی اینجاست که سؤال "چه زمانی ماشینها از ما باهوش تر می شوند و همه را به بردگی می گیرند؟" در ابتدا اشتباه است بسیاری از شرایط پنهان در آن وجود دارد.

ما می گوییم "از ما باهوش تر شوید" مثل اینکه منظور ما این است که مقیاس یکپارچه ای از اطلاعات وجود دارد. قسمت بالای آن یک انسان است و حیوانات پایین تر از انسان.

اگر این طور بود ، هر انسانی باید حیوانات را در همه چیز مورد ضرب و شتم قرار دهد اما این درست نیست. سنجاب متوسط می تواند هزار مکان پنهان با آجیل را به خاطر آورد - حتی نمی توانم به یاد داشته باشم که کلیدهای من کجا هستند.

بنابراین هوش مجموعه ای از مهارت های مختلف است ، نه یک ارزش واحد قابل اندازه گیری؟ یا آیا به خاطر سپردن مکانهای آغشته به آجیل در هوش نیست؟

یک سوال حتی جالب تر برای من - چرا ما اعتقاد داریم که امکانات مغز انسان محدود است؟ نمودارهای رایج زیادی در اینترنت وجود دارد که پیشرفت تکنولوژی به عنوان یک عامل ترسیم شده و امکانات انسانی ثابت است.

باشه ، همین الان 1680 در 950 را در ذهن خود ضرب کنید. من می دانم که شما حتی امتحان نمی کنید. اما یک ماشین حساب به شما بدهند - این کار را در دو ثانیه انجام خواهید داد. آیا این بدان معنی است که ماشین حساب فقط قابلیت های مغز شما را گسترش داده است؟